3月16日晚,埃隆·马斯克在外交平台发文称,Kimi这项责任“令东谈主印象深切”(Impressive work from Kimi),将中国东谈主工智能公司月之暗面(Moonshot AI)Kimi团队一项新近公开的本事遵守带入更多公众视线。

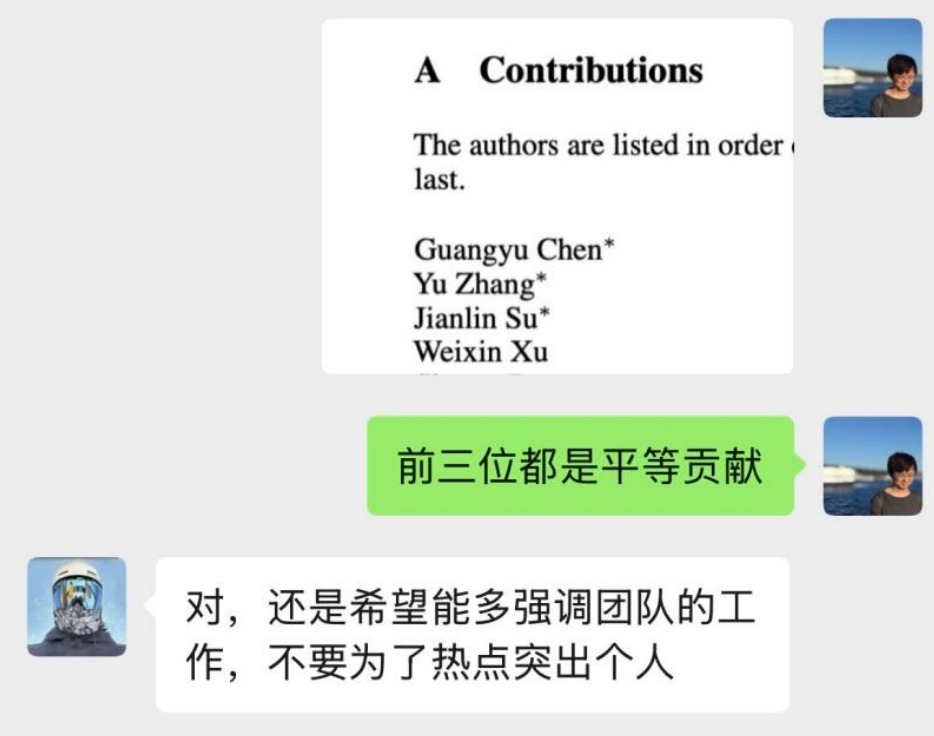

随后,这篇同日发布的本事论文中,排在作家名单第一位的“Guangyu Chen”,因其“17岁高中生”身份激发外交平台存眷。记者独家干系并核实得知,这位作家即陈广宇,来自深圳,面前依然别称在读高中生。陈广宇在收受记者采访时暗意,但愿外界少写个东谈主、多写本事和团队,不要为了热门隆起个东谈主,这项责任是团队共同完成的遵守。

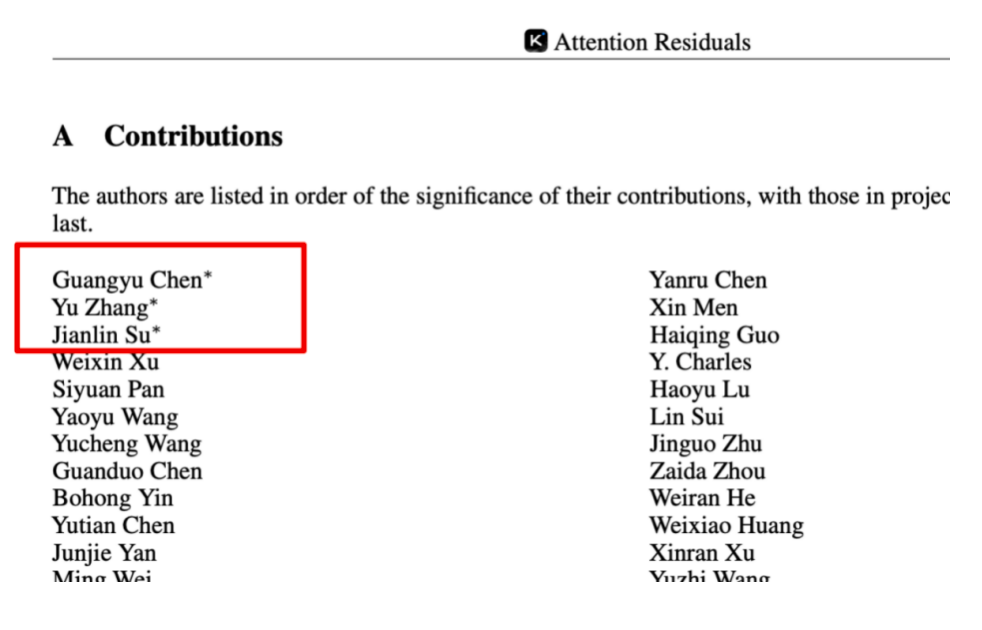

公开论文附录清爽,Guangyu Chen、Yu Zhang、Jianlin Su前三位作家均被标注为“同等孝顺”(Equal contribution),其余34位作家姓名后均未见这一标注。与陈广宇比肩共合并作的另外两东谈主,差异是张宇和苏剑林。前者是Kimi高效模子架构的蹙迫照管者,后者则是大模子鸿沟有名照管者,其建议的旋转位置编码(RoPE)已成为主流大模子平淡罗致的位置编码措施之一。

这项遵守受到存眷,不仅因为作家名单中出现了别称高中生,且位列共合并作,也因为它波及了大模子一块长期沿用、却较少参加公众视线的底层结构。

今上帝流大模子大多建立在Transformer架构之上。不错说,莫得2017年建议的Transformer,就很难有自后这一轮生成式东谈主工智能的快速发展。它改造了文本里面的信息处理形状,但模子层与层之间怎样传递信息,长期仍沿用较为固定的宗旨。包括OpenAI集中独创东谈主伊尔亚·苏茨克维在内,一些照管者都曾想考,这种连结形状是否还能被改写。

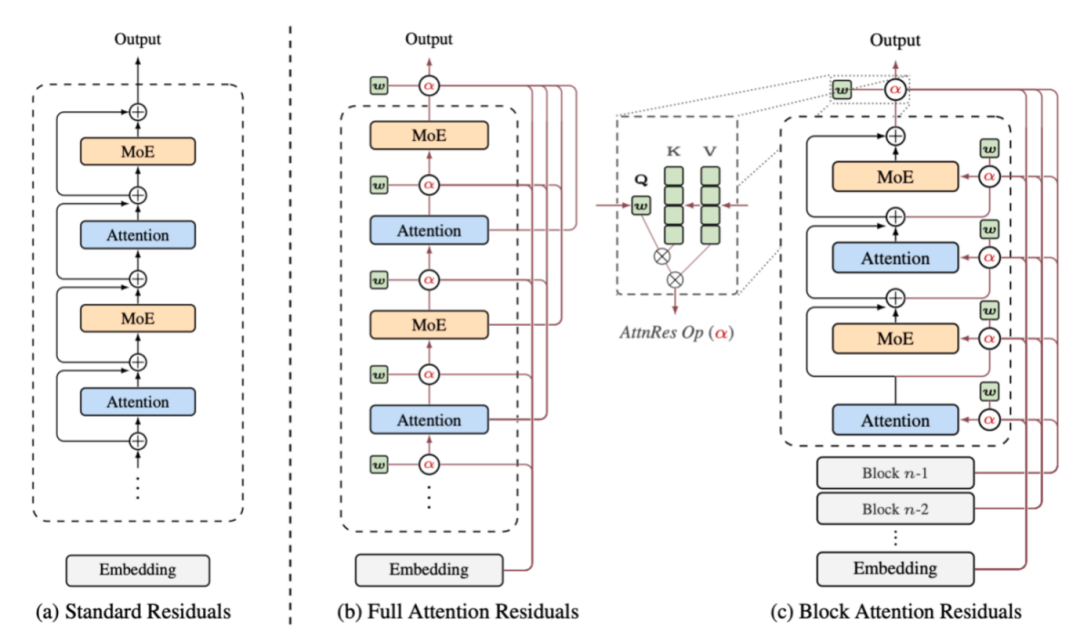

已往常用的是“残差连结”。浅易说,即是每算完一层,就把前边的信息凯旋加到下一层。这么作念浅易灵验,但层数一深,委果蹙迫的信息也容易被禁止累加的试验冲淡。

Kimi团队此次建议的“驻守力残差”(Attention Residuals),即是想惩处这个问题。它不再让每一层无判袂招揽前边统共层的信息,米兰体育而是由刻下层按需聘请更值得参考的试验再加以团员。普通地说,已往像把统共府上整包往后传,当今更像先翻一遍,再挑出最有用的几页带走。

传统残差连结与驻守力残差结构对比图

这项责任的意旨在于,它提供了另一条想路:大模子智商擢升,偶而只可靠堆参数、堆算力,也不错从底层结构起原,提高信息诈欺遵守。公开材料清爽,这一措施已在Kimi Linear 48B模子上完成考据,在左右效果下老师计较量可减少约20%,很是于约1.25倍遵守上风,推理延伸加多不到2%,且可凯旋替换圭表残差连结。干系解读合计,引入“驻守力残差”后,模子缱绻可能重新存眷“加深深度”这一王人径,而不仅仅连续向更大参数鸿沟扩张。

陈广宇委果深入构兵东谈主工智能照管,是近一年的事。起步阶段,他通过研读经典论文、跟踪GitHub开源款式等形状补上基础领略。自后,他因在外交平台上共享对本事博客的反想,引起一家硅谷AI初创公司CEO存眷,并在通过一项限时实验测试后获取实习契机。暑假时辰,他赶赴好意思国实习七周,归国后于旧年11月到Kimi团队实习。

陈广宇个东谈主网站,列有其参与的多个款式

论文发布后,他在一又友圈归来这段阅历时,非常提到同等孝顺作家(Equal contribution)以及从事模子扩张与基础法子(scaling、infra)责任的共事,称这项责任“不行偏废”。

在收受记者采访时,陈广宇屡次重叠相同的深嗜深嗜:不要“造神”,不但愿被写成隆起个东谈主的故事。对这名来自深圳的17岁少年而言,比起被写成“天才”,他更但愿外界看到的,是一项团队共同完成的照管米兰体育app官网,以及它试图惩处的大模子底层艰巨。

乐鱼体育官方网站

备案号:

备案号: